Crítica a la Relación entre la Inteligencia Artificial y la Evolución Humana: Una Reflexión Ética y Metafísica

Introducción

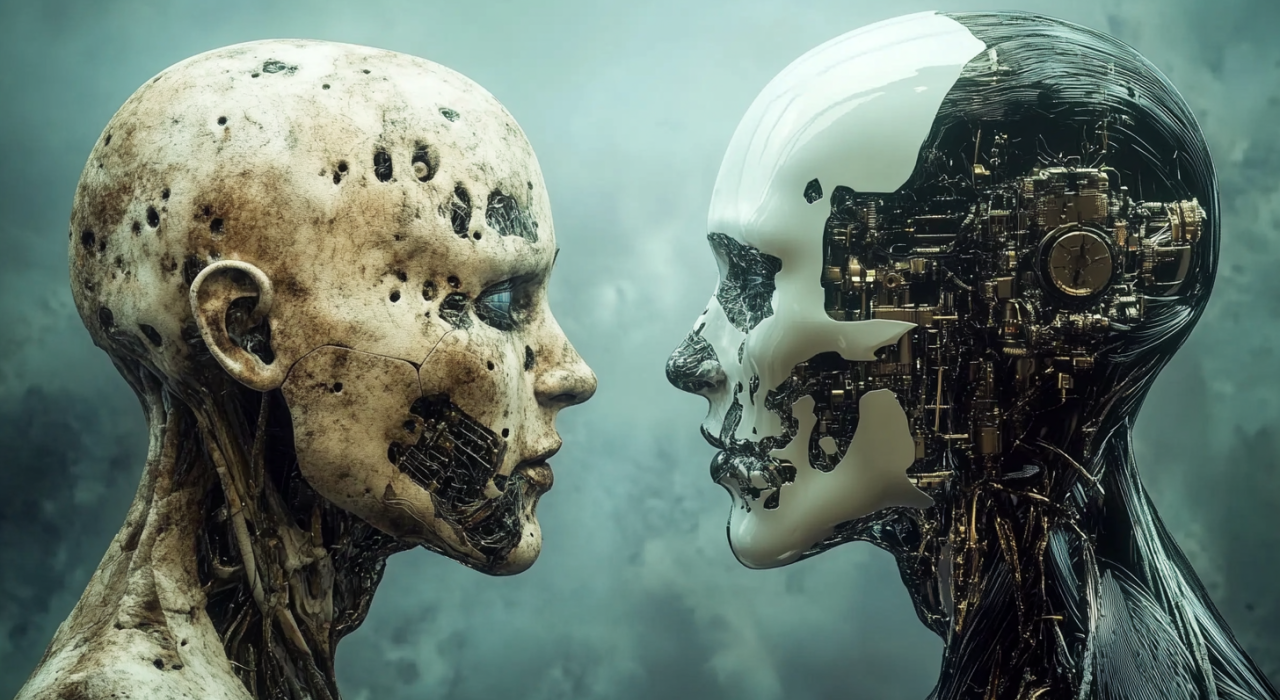

En la actualidad, la inteligencia artificial (IA) se ha convertido en un componente crucial del desarrollo tecnológico humano, presentada por algunos como una extensión de nuestra propia evolución. Sin embargo, equiparar el progreso tecnológico con la evolución biológica plantea serias interrogantes filosóficas. Mientras que la evolución biológica se centra en la adaptación y supervivencia de las especies, el desarrollo de la IA no sigue una dirección clara ni busca el mismo fin. Este ensayo tiene como objetivo criticar la idea de que la IA forma parte de la evolución humana, así como reflexionar sobre los problemas éticos que plantea. A través de las ideas de Lyotard, Bauman y Foucault, se abordará una crítica profunda sobre la IA y su desarrollo en manos de actores privados y se discutirá cómo la ética de la IA ha sido tratada en diferentes foros y guías internacionales.

La IA y la Evolución: Un Análisis Conceptual Crítico

La evolución biológica se define como un proceso de selección natural que permite la adaptación de las especies a su entorno con el fin de asegurar su supervivencia. No obstante, cuando el concepto de evolución se traslada al ámbito tecnológico, y en particular a la IA, surge una contradicción. La IA no responde a las mismas presiones adaptativas de la naturaleza, ni busca la supervivencia de una especie. En este contexto, la noción de “evolución” aplicada a la IA carece de sentido en términos biológicos.

Jean-François Lyotard, en La condición posmoderna, sostiene que las grandes narrativas, como el progreso científico o tecnológico, han perdido su credibilidad en la sociedad contemporánea. La fragmentación del conocimiento y la pérdida de fe en los metarrelatos sugieren que no existe un progreso lineal o universal en el desarrollo de la tecnología. Aplicando este pensamiento a la IA, podemos ver que no hay una evolución unificada o universalmente aceptada. El desarrollo de la IA no es lineal ni responde a una necesidad biológica, sino que está fragmentado y condicionado por intereses económicos y políticos.

En este sentido, la IA no debería considerarse una extensión natural de la evolución humana, sino una creación tecnológica cuyo propósito y dirección están determinados por factores ajenos a la biología.

Zygmunt Bauman, en su obra Modernidad líquida, describe un mundo en constante cambio, donde las estructuras sociales, económicas y tecnológicas son cada vez más inestables. En este contexto, la IA no ofrece la seguridad o el bienestar que se asocia tradicionalmente con el progreso tecnológico. En cambio, contribuye a la precariedad social y a la fragmentación de las relaciones humanas. La IA, en lugar de ser un garante de estabilidad, se convierte en un motor de incertidumbre y ansiedad.

Bauman critica cómo las promesas de progreso no se materializan para la mayoría de la población, y la IA no es una excepción a esta regla. La tecnología avanza, pero no en beneficio de todos, sino de aquellos que controlan su desarrollo. Esto genera nuevas formas de desigualdad, ya que mientras algunos sectores de la sociedad se benefician de la IA, otros se ven perjudicados por la automatización y la precarización del trabajo.

Michel Foucault, en Vigilar y castigar, analiza cómo las instituciones modernas utilizan tecnologías de vigilancia para ejercer poder y control sobre las poblaciones. La IA, bajo el discurso del progreso y la mejora tecnológica, es una herramienta que permite a las corporaciones y gobiernos recolectar y analizar datos a una escala sin precedentes, lo que refuerza los mecanismos de vigilancia y control. La IA no es simplemente un avance tecnológico, sino una extensión de los sistemas de poder que disciplinan a los individuos y refuerzan las jerarquías existentes.

En este sentido, el desarrollo de la IA no es neutral, sino que está intrínsecamente ligado a relaciones de poder. El progreso tecnológico que promueve la IA perpetúa las estructuras de control sobre los individuos, limitando su libertad y autonomía.

Reflexión Ética: La IA en Manos Privadas y la Desconexión con el Bien Común

Hace varios años que la ética de la IA se ha debatido en diversas conferencias y foros internacionales. Un ejemplo destacado es la Asilomar Conference on Beneficial AI en 2017, organizada por el Future of Life Institute, donde se discutió cómo desarrollar la IA de manera responsable y ética. Sin embargo, desde 2019, ha habido un despertar crítico con respecto a los problemas éticos que plantea la IA. En ese año, la Unión Europea publicó una serie de directrices éticas que incluían siete requisitos clave que los sistemas inteligentes deben cumplir, como el respeto a la privacidad, la promoción del bienestar y la eliminación de sesgos.

Además, organizaciones como el ATOMIUM European Institute for Science, Media and Democracy han realizado encuentros, como el Forum for Good AI Society, que han presentado hasta 20 recomendaciones éticas para la IA. Del mismo modo, la ONU y la UNESCO han contribuido con guías y documentos sobre IA, destacando iniciativas como la plataforma IA for Good de la ONU. Es evidente que la ética de la IA ha sido objeto de debate durante varios años y ha dado lugar a importantes esfuerzos por parte de diversas organizaciones para guiar su desarrollo.

A pesar de estos avances, mi crítica personal se centra en la desconexión que existe entre estas discusiones éticas y la forma en que la mayoría de la población interactúa con la IA. Para muchos, la IA es simplemente un producto de consumo, encapsulado en plataformas y aplicaciones que no reflejan el desarrollo filosófico y ético que está ocurriendo en foros especializados. No participamos en el desarrollo de la IA; somos meros consumidores de sus productos. La IA, lejos de ser una herramienta de mejora social, se ha convertido en un bien de consumo, controlado por las grandes corporaciones tecnológicas.

Un claro ejemplo de esto es OpenAI, que comenzó como una organización sin fines de lucro y ahora está en proceso de transformarse en una empresa privada. Este cambio revela la forma en que la ética queda relegada frente a los intereses económicos. Las recientes disputas dentro de OpenAI, como la salida de Ilya Sutskever y otros directivos, reflejan las tensiones internas en torno a la neutralidad de la empresa y su inclinación hacia las ganancias. Esto plantea serias preocupaciones sobre la dirección que está tomando el desarrollo de la IA.

La IA está en manos privadas, y el poder que estas empresas tienen sobre su desarrollo es comparable al control que los gobiernos ejercen sobre las armas nucleares o biológicas. Si un oligopolio tecnológico controla la IA, no para promover el bienestar común, sino para maximizar sus ganancias, ¿qué futuro le espera a la humanidad? Es fundamental que no solo se implementen regulaciones más estrictas, sino que también se reevalúe el modelo económico que rige el desarrollo de la IA. Si no se toman medidas, la IA se convertirá en una herramienta más para la acumulación de capital, amplificando las desigualdades y profundizando los problemas estructurales del sistema capitalista.

Conclusión

La inteligencia artificial no forma parte de la evolución humana en el sentido biológico, ya que no responde a las dinámicas de adaptación que caracterizan la evolución natural. Más bien, la IA es una construcción tecnológica que refleja las tensiones y contradicciones de la sociedad contemporánea. Michel Foucault nos enseña que el progreso no es neutral, sino que está vinculado a las relaciones de poder que disciplinan a las poblaciones. Desde la crítica marxista, es evidente que el desarrollo de la IA está siendo instrumentalizado por el capital para perpetuar las desigualdades y consolidar el poder de las élites tecnológicas.

El debate sobre la ética de la IA es esencial, pero no suficiente. La IA debe ser regulada y su desarrollo no puede quedar en manos de actores privados cuyo principal interés es la acumulación de capital. De lo contrario, la IA, lejos de ser un motor de progreso, se convertirá en un instrumento de explotación y control. La intervención crítica y la reflexión filosófica son urgentes si queremos que la IA beneficie a la humanidad en su conjunto, y no solo a una minoría privilegiada.

Referencias Bibliográficas

- Lyotard, J.-F. (1979). La condición posmoderna. Ediciones Cátedra.

- Bauman, Z. (2000). Modernidad líquida. Fondo de Cultura Económica.

- Foucault, M. (1975). Vigilar y castigar. Siglo XXI Editores.

- Marx, K. (1867). El capital. Fondo de Cultura Económica.

- Future of Life Institute. (2017). Asilomar AI Principles.

- Unión Europea. (2019). Directrices Éticas para una Inteligencia Artificial Confiable.

- ATOMIUM European Institute for Science, Media and Democracy. (2020). Forum for Good AI Society.

- UNESCO. (2020). IA for Good Global Summit.